Es scheint, dass die Befürchtungen der Privatsphäre und des Datenschutzes in Bezug auf sprachbetriebene Geräte wahr geworden sind; zumindest in einem einzigen Fall, in dem Amazon die Sprachdaten eines Kunden an einen anderen Kunden weitergegeben hat.

Was ist passiert? Laut (PDF) der deutschen Computerzeitschrift CT bat einer der deutschen Kunden von Amazon um Zugang zu den Daten, die das Unternehmen über ihn gespeichert hatte. Amazon schickte dem Kunden ein ZIP-Archiv mit den Daten und der Kunde begann es zu analysieren.

Er bemerkte, dass das Archiv etwa 1700 WAV-Dateien und ein PDF-Dokument enthielt, das Alexa-Transkripte enthielt. Der Kunde besaß oder benutzte keine Alexa-Geräte und kam nach dem Abspielen einiger Audiodateien schnell zu dem Schluss, dass die Aufnahmen nicht seine waren.

Der Kunde kontaktierte Amazon wegen des Vorfalls, aber es kam nichts dabei heraus; er beschloss, sich mit CT in Verbindung zu setzen und stellte CT eine Probe der Dateien zur Verfügung. Die Audioaufnahmen lieferten viele Informationen über den damals unbekannten Amazon-Kunden, darunter wo und wie Alexa verwendet wurde, Informationen zu Jobs, Personen, Alarmen, Likes, Heimanwendungssteuerung und Transportanfragen.

CT hat ein Profil des Benutzers erstellt und konnte damit den Kunden, seine Freundin und einige Freunde identifizieren. CT kontaktierte den Kunden und er bestätigte, dass seine Stimme auf den Aufnahmen zu sehen war.

Amazon sagte dem Magazin, dass das Leck "ein bedauerliches Missgeschick war, das auf menschliches Versagen zurückzuführen ist". Amazon hat beide Kunden kontaktiert, nachdem CT das Unternehmen kontaktiert hatte.

Datenschutzproblem

Amazon speichert Alexa-Sprachdaten auf unbestimmte Zeit in der Cloud. Das Unternehmen tut dies, um "seine Dienstleistungen zu verbessern". Die Daten können verwendet werden, um Besitzer von Alexa-Geräten und andere zu identifizieren, die in Aufzeichnungen erwähnt werden oder bei Aufzeichnungen hörbar sind. Es hängt zwar davon ab, wie Alexa-Geräte verwendet werden, aber es ist klar, dass die Aufzeichnungen private Informationen enthalten, die den meisten, wenn nicht allen Kunden sehr unangenehm wären, wenn sie an andere weitergegeben würden.

Die meisten Besitzer von sprachgesteuerten Geräten sind sich wahrscheinlich nicht bewusst oder gleichgültig, dass ihre Daten auf unbestimmte Zeit in der Cloud gespeichert werden.

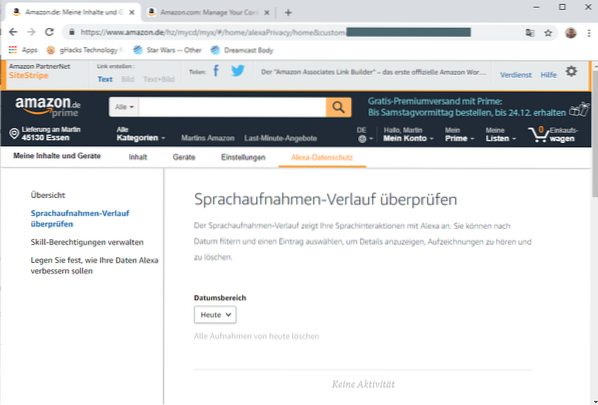

Amazon-Kunden können Sprachaufzeichnungen, die Amazon in der Cloud gespeichert hat, unter https://amazon . löschen.de/alexaprivacy/. Ich konnte nicht auf die Funktionen auf der Hauptwebsite von Amazon zugreifen, https://amazon.com/alexaprivacy/, da die Anfrage automatisch umgeleitet wurde.

Die deutsche Seite ist zugänglich und bietet Optionen zum Löschen von Aufnahmen, die Amazon gespeichert hat. Es gibt jedoch keine Möglichkeit, Amazon von vornherein daran zu hindern, Aufzeichnungen zu speichern. Es ist unklar, ob die Seite nur für deutsche Kunden oder alle Amazon-Kunden funktioniert.

Schlussworte

Unternehmen müssen menschliche Fehler berücksichtigen, wenn es um Datenschutzlecks und -verletzungen geht. Der Fall Amazon zeigt, dass Lecks aus zahlreichen Gründen auftreten können, darunter erfolgreiche Hacking-Versuche, Softwarefehler oder menschliches Versagen.

Jetzt du: Verwenden Sie sprachgesteuerte Geräte??

Phenquestions

Phenquestions